※本記事はBotの設計や開発に興味ある方向けの記事です。イベント当日話した内容を掻い摘んで文字におこしています。

イベント概要

「LINE Developer Meetup」とは、LINEが主催している開発者向けの勉強会です。

以前東京で開催された同イベントのLTに参加したことがキッカケで、主催の方から声をかけて頂き、話すことになりました。

LINEが提供しているAPIは こちら

イベント詳細

https://line.connpass.com/event/95135/

発表スライド

登壇内容

これまで僕自身のBot開発経験やいろいろなBotを触ってみての実体験 + Bot設計に関する書籍をもとに、「BotにおけるUI/UX設計ノウハウ」について話しました。

<関連書籍>

書籍からの引用ではありますが、Bot(というよりスマートスピーカーも含めた会話型UI)は「"transparent" user experience(透明なUX)」と表現されています。

確かに、単純なテキストメッセージのやり取りだけだと印象に残らないですよね。(対人でも顔文字や絵文字、スタンプで感情表現しますし)

そして印象に残らないと、いざという時に「あのBot使おう!」ともなりませんよね。

ということで、

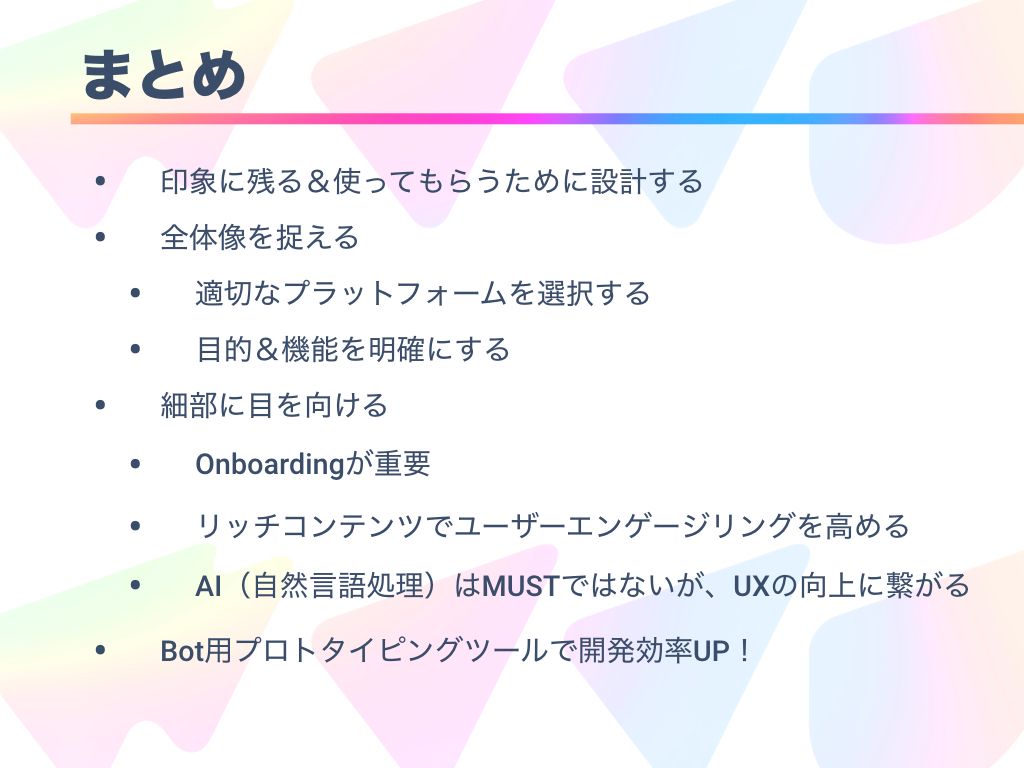

印象に残る&使ってもらうために、BotのUI/UX設計は必要。

と定義しておきます。

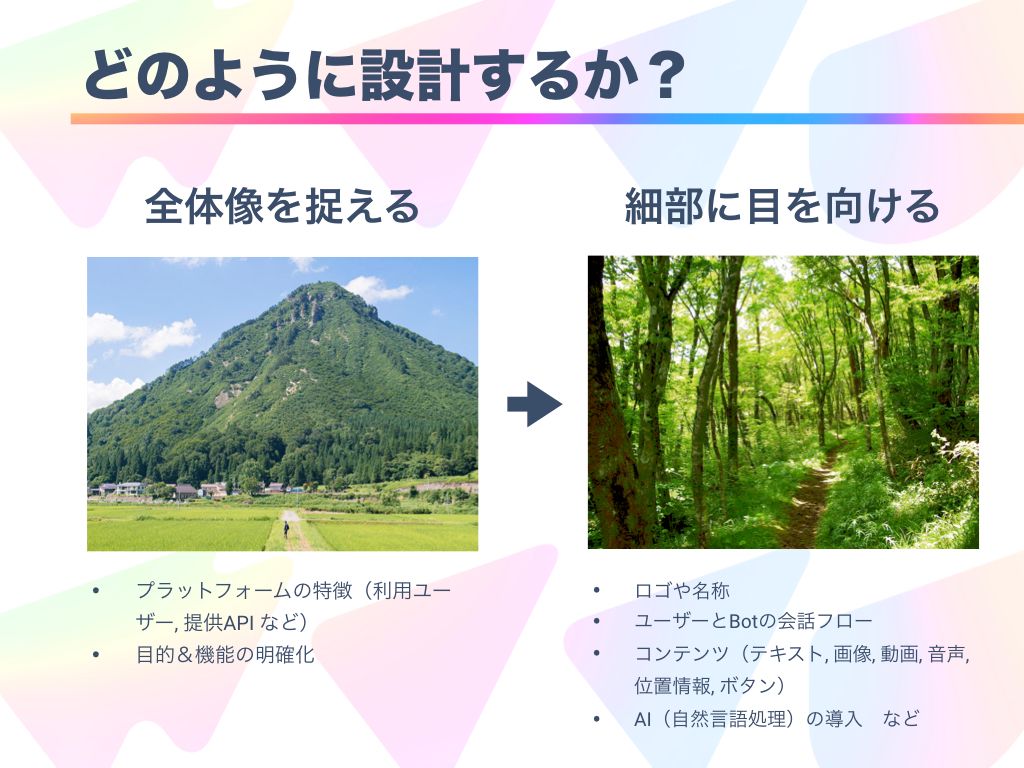

どんな設計でも同じだとは思うのですが、「全体像を捉える」→「細部に目を向ける」が鉄則の流れです。

Botにおける「全体像を捉える」とは

一つは、Botをのせるプラットフォームの特徴を知ることです。 LINEとSlackを比べても、プラットフォームの差はかなり違います。

- 利用ユーザー(LINE=オープンでC向け、Slack=クローズドでB向け)

- 利用デバイス(LINE=スマホ大多数、Slack=PC>スマホ)

- 提供API(独自UI含む)

もう一つは、Botの目的&機能を明確にすることです。 スタートアップの世界では、MVP: Minimal Viable Product(顧客に価値を提供できる最小限の製品)と呼ばれることも多いですが、これを見つける感覚に近いと思います。

Botにおける「細部に目を向ける」とは

プラットフォームや実現したい機能によって異なりますが、以下の項目が挙げられることが多いと思います。

- ロゴや名称

- ユーザーとBotの会話フロー

- コンテンツ(テキスト, 画像, 動画, 音声, 位置情報, ボタン)

- AI(自然言語処理)の導入

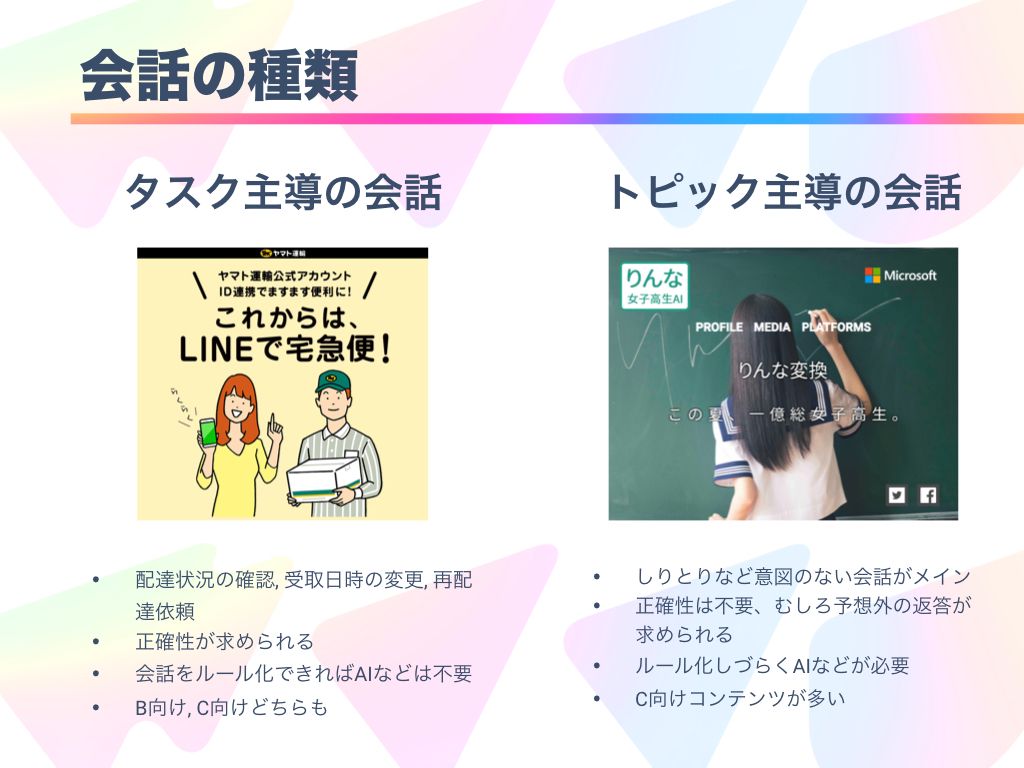

Botとの会話には大きく2種類「タスク主導の会話」と「トピック主導の会話」があります。

タスク主導の会話

ヤマト運輸の公式LINEアカウントの場合、

- 配達状況の確認

- 受取日時の変更

- 再配達依頼

が主なタスクになります。

これらのタスクは、正確性が求められます。(希望と誤った日時に変更されていたら二度と使いたくなくなりますよね)

トピック主導の会話

この会話には正確性は必要なく、むしろ予想外の返答が求められます。

女子高生AIで有名なりんなのLINE公式LINEで「歌えるか?」「絵を描けるか?」聞いてみました。

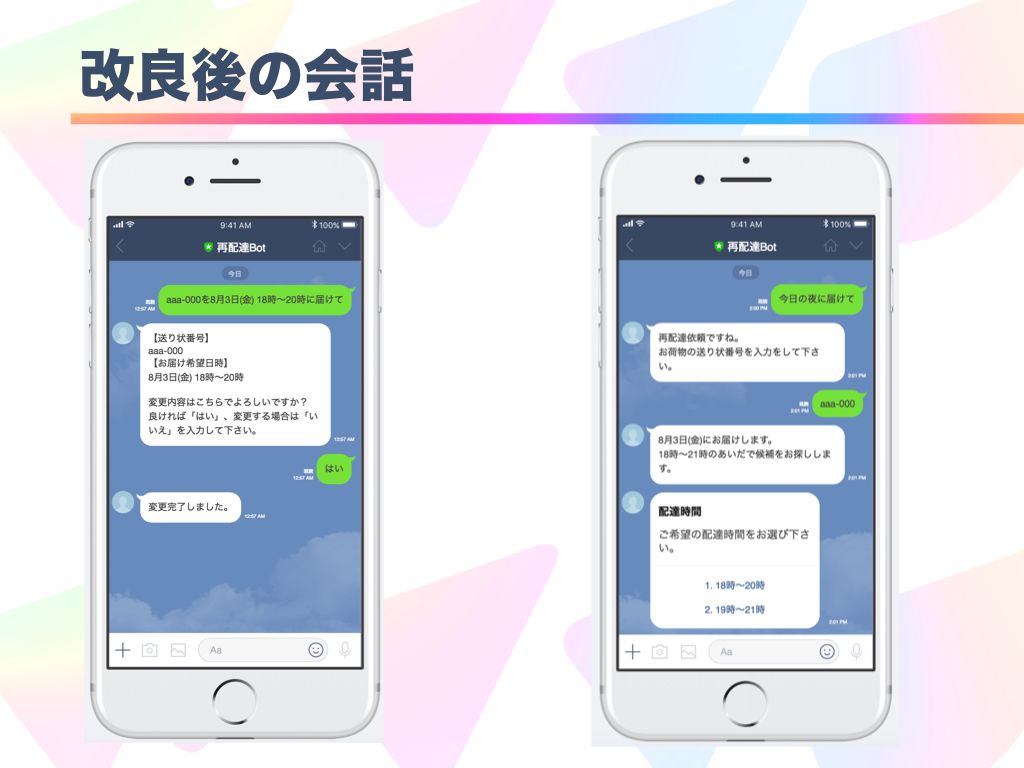

具体的な設計の話に入っていきます。 前述のヤマト運輸にならい「再配達Bot」を開発すると仮定します。 左右どちらのBotを使ってみたいと思いますか?

Onboardingとは、 組織の一員やサービスのユーザーとして新しく加入したメンバーに手ほどきを行い、慣れさせるプロセスのこと。 上記の場合、再配達Botを初めて友達登録した後の話です。

左の場合、 テキストが送られて来ただけなので、次にどうアクションして良いのか分からないですよね。 「再配達依頼」とテキスト入力?でもするのでしょうか。

右の場合、 下部にメニューボタンが表示されているため、とりあえず押したら次へ進めそうです。 また、次回以降のアクセス時も表示されるので、Botの使い方を覚えるコストも減ります。

このように、テキストメッセージのみではなく、画像や動画・ボタンなどグラフィックで表現することによって、コンバージョン率をグッと伸ばすことが可能です。

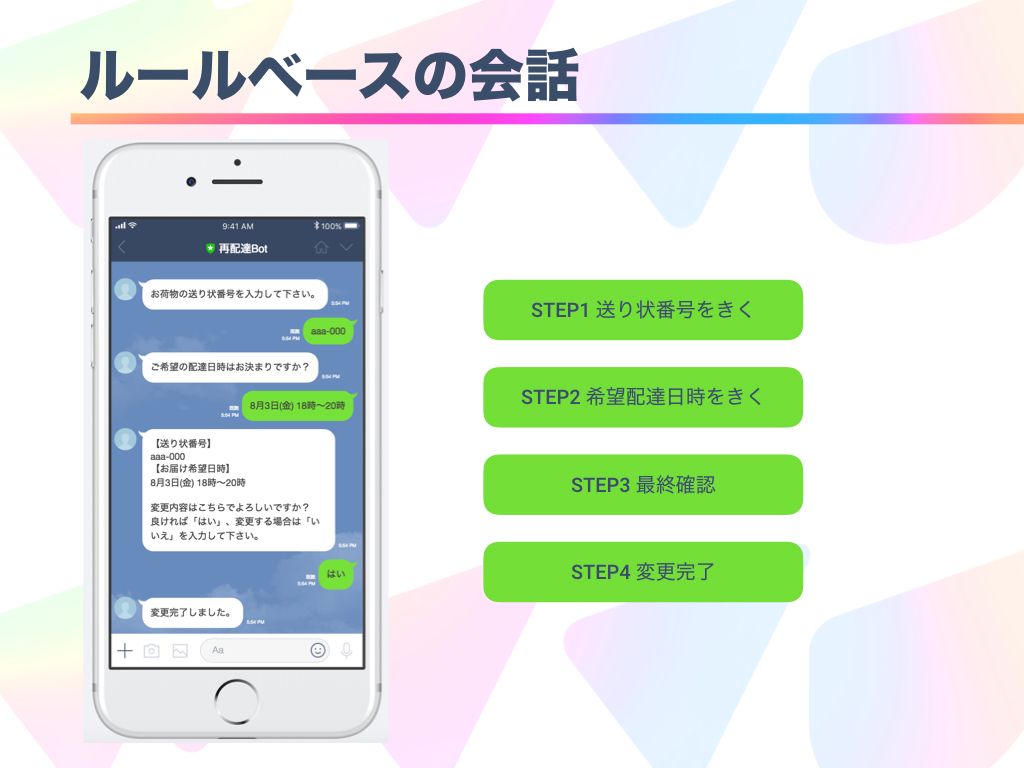

次に、再配達の会話フローの設計に移ります。

ベースとなる会話フローは、以下のとおりです。

- STEP1 送り状番号をきく

- STEP2 希望配達日時をきく

- STEP3 最終確認

- STEP4 変更完了

これだけの処理で良いなら、IF分岐を駆使して処理が書けそうです。

ただ、以下のようなユーザー入力がされた場合、IF分岐を増やすだけでは追いつかなくなります。

- 送り状番号と希望配達日時を同時に入力されたら?

- 配達日時に「本日」や「夜」と入力されたら?

- 送り状番号と希望配達日時を逆に入力されたら?

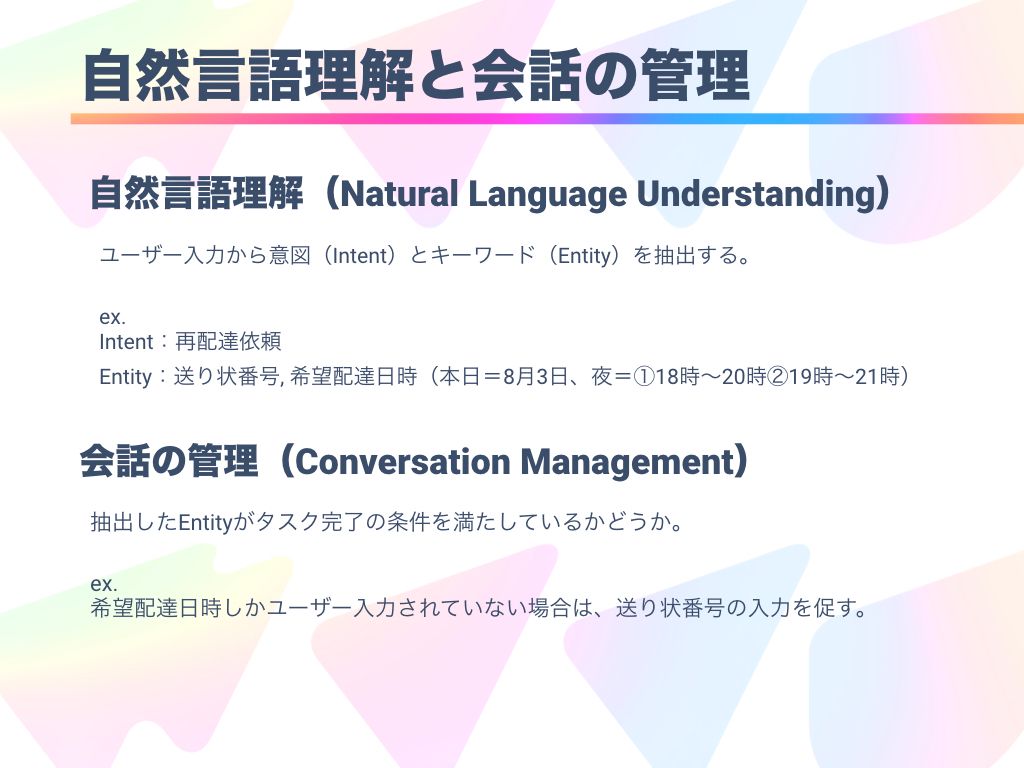

そこで、AI(というよりは自然言語処理ですが)を導入することによって選択肢が広がります。

現時点のNLU+Conversation Managementのツールとしては、以下が有力でしょう。

- Dialogflow(Google)https://dialogflow.com

- Watson Assistant(IBM)https://www.ibm.com/watson/jp-ja/developercloud/conversation.html

- LUIS(Microsoft)https://www.luis.ai

- Amazon Lex(Amazon、日本語未対応)https://aws.amazon.com/jp/lex/

20分という限られた時間だったので、重要な割合を占める導入部について話しました。実際に開発してみないと分からないことも多々あると思うので、ぜひ手を動かしてみて下さい!